如何快速優化SEO-5分鐘搞定網頁的robots meta

目錄

甚麼狀況下該使用 robots meta 與 robots.txt

robots meta 對 SEO 的操作上也是很重要。robots meta 與 robots.txt 都能向搜尋引擎宣告如何處理網頁。前者為阻止搜尋引擎索引你的頁面 (但搜尋引擎還是有抓取你的網站資料) ; robots.txt 則是全面阻止搜尋引擎抓取你的資料 (搜尋引擎會自動略過你指定的網站)。

當然,大多數的狀況,你不會讓 robots.txt 來阻止搜尋引擎抓取辛苦建立的網站。但是以若這個網站對你的 SEO 有負面影響、或是私密性高的話,就可以用robots.txt 來阻擋搜尋引擎抓取,常見的情況如下所示:

1. 多年前有經過黑帽 SEO 手法,卻還沒處理的網頁、

2. 施工中未完成的網頁等

3. 網站或是公司內部系統的登入頁面

若你只是希望這個網頁不要出現在搜尋引擎結果中的話,那用 robots meta 即可。

如何設定網站 robots.txt

- User-agent

指定哪一種搜尋引擎的爬蟲,如 Google 的爬蟲 「googlebot」或是百度的爬蟲等等(* 號代表全部) - Crawl-delay

限制爬蟲抓取每一頁的秒數限制,但是該設定會被 Google 跳過不處理。因為 Google 在網站管理員中,就有爬取頻率的設定。 - Disallow

輸入你不允許被爬取的 URL 路徑 - Allow

輸入你允許被爬取的 URL 路徑 - Sitemap

告知搜尋引擎的 Sitemap 網址

- 拒絕所有的搜尋引擎爬蟲爬取你的網站:

User-agent:*

Disallow: / - 允許全部的搜尋引擎爬蟲爬取你的網站:

User-agent:*

Disallow: / - 拒絕 Google 的搜尋引擎爬蟲爬取 /wp-admin 目錄

User-agent:*

Disallow: /wp-admin/ - 只拒絕百度的搜尋引擎爬蟲,卻允許其他搜尋引擎 (如 Google、Yahoo、Yandax等等) 爬取

User-agent:Baiduspider

Disallow: /

User-agent:*

Allow: / - 拒絕搜尋引擎爬取特定類型的檔案

User-agent:*

Disallow: /*.ini$

Disallow: /*.jpg$ - 實際網站完整 robots.txt

User-agent:*

Crawl-delay: 7

Disallow: /wp-admin/

Disallow: /cgi-bin/

Disallow: /readme.html/

Disallow: /*.ini$ sitemap: http://codingbomb.com.tw/sitemap.xml

robots.txt-如何設定?

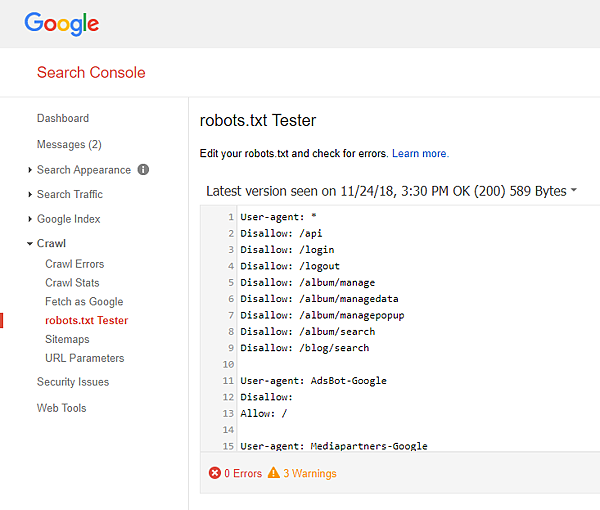

舊版的 Google 網站管理員 Search Console 中,有 robots.txt 測試工具,他會模擬 Google 搜尋引擎爬蟲來檢查你的 robots.txt 的正確性。

如何設定網站 robots meta

屬性值#1,為指定哪種搜尋,常用語法如下:

屬性值#2,為指定處理方式,常見代碼如下

原文出處:https://www.tedu.tw/blog/seo-robots-meta.html

相關文章:

元宇宙也有翻譯蒟蒻了!Meta推全球語言都可翻譯的人工智慧

Google提出Android隱私沙盒,標榜保護用戶資料安全

導盲犬被 AI 取代?美科學家研發四足機器導盲犬

【糖友福音】加拿大人工智慧新創 Scanbo 免扎針血糖儀,一分鐘驗出

人工智慧醫療再躍進!AI測腸癌靈敏度99.7%!

人工智慧拯救爛畫質,經典老動漫變高清!

必勝客人工智慧做一個披薩只需1.2分鐘!